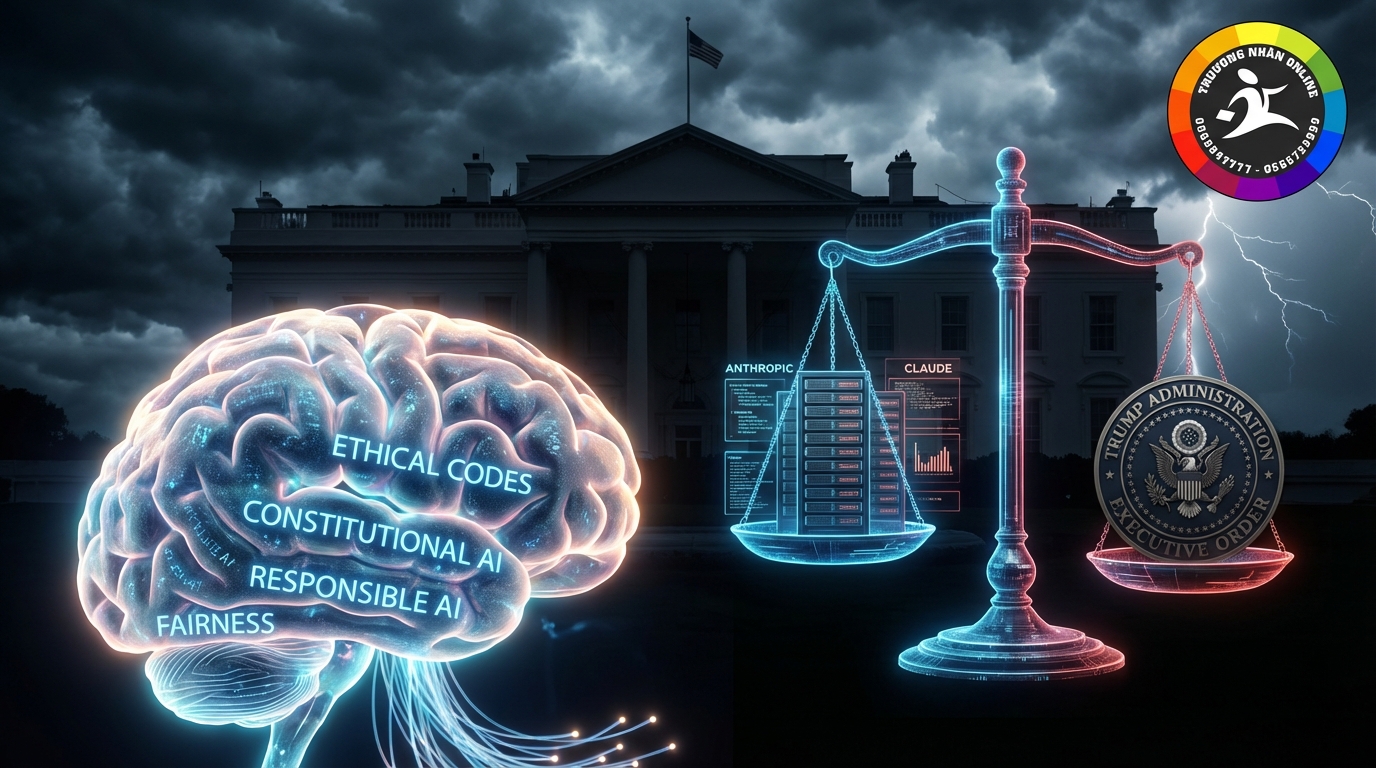

Cuộc Chiến Pháp Lý: Anthropic Kiện Chính Quyền Trump Để Bảo Vệ Đạo Đức AI

Thế giới công nghệ đang chứng kiến một cuộc đối đầu chưa từng có tiền lệ. Anthropic, công ty đứng sau mô hình ngôn ngữ lớn Claude nổi tiếng, đã quyết định thực hiện một bước đi táo bạo: kiện chính quyền của Tổng thống Donald Trump ra tòa án liên bang. Quyết định này được đưa ra ngay sau khi Nhà Trắng ban hành sắc lệnh cấm các cơ quan chính phủ và đối tác liên bang sử dụng các mô hình trí tuệ nhân tạo của Anthropic, với lý do hãng này không tuân thủ các yêu cầu về an ninh và giám sát quốc gia.

1. Ngòi nổ của cuộc khủng hoảng: Sắc lệnh hành pháp và sự phản kháng

Vụ việc bắt nguồn từ một loạt yêu cầu của chính quyền mới nhằm tích hợp AI sâu hơn vào các hệ thống giám sát trong nước và phát triển các hệ thống vũ khí tự hành hoàn toàn. Tổng thống Donald Trump, với quan điểm ưu tiên sức mạnh quân sự tuyệt đối và kiểm soát biên giới chặt chẽ, đã thúc đẩy các công ty AI phải chia sẻ mã nguồn và cấp quyền truy cập ‘cửa sau’ cho các cơ quan tình báo. Tuy nhiên, Anthropic đã kiên quyết từ chối. Phản ứng trước sự cứng rắn này, Nhà Trắng đã ban hành một lệnh cấm diện rộng, cắt đứt mọi hợp đồng nghiên cứu và triển khai có liên quan đến Anthropic.

Phát ngôn viên của Anthropic tuyên bố: ‘Chúng tôi không xây dựng công nghệ để trở thành công cụ của sự áp bức hay giết chóc tự động. Việc kiện chính quyền là nỗ lực cuối cùng để bảo vệ các nguyên tắc cốt lõi về đạo đức AI mà chúng tôi đã cam kết với người dùng và nhân loại’. Đây không chỉ là một vụ kiện kinh tế về việc mất hợp đồng chính phủ, mà là một cuộc chiến tư tưởng về việc ai sẽ kiểm soát ‘bộ não’ của tương lai.

2. Triết lý ‘Constitutional AI’ – Lằn ranh đỏ của Anthropic

Để hiểu tại sao Anthropic sẵn sàng đối đầu với Nhà Trắng, chúng ta cần nhìn vào nền tảng của họ: Constitutional AI (AI Hiến pháp). Không giống như các mô hình khác dựa hoàn toàn vào phản hồi từ con người để học tập, Claude được xây dựng trên một tập hợp các nguyên tắc đạo đức rõ ràng — một ‘bản hiến pháp’ cho AI. Bản hiến pháp này cấm mô hình hỗ trợ các hoạt động xâm phạm quyền riêng tư quy mô lớn hoặc tham gia vào việc phát triển các vũ khí gây sát thương không có sự kiểm soát của con người.

Việc chính quyền Trump yêu cầu Anthropic tinh chỉnh mô hình để phục vụ giám sát đại trà trực tiếp vi phạm ‘bản hiến pháp’ này. Các chuyên gia phân tích rằng, nếu Anthropic nhượng bộ, họ sẽ đánh mất niềm tin từ khách hàng doanh nghiệp và cộng đồng nghiên cứu toàn cầu, đồng thời phá hủy bản sắc thương hiệu là ‘công ty AI an toàn nhất thế giới’. Dario Amodei, CEO của Anthropic, đã nhiều lần khẳng định rằng an toàn AI không phải là một lựa chọn, mà là một yêu cầu bắt buộc đối với sự tồn vong của nhân loại.

3. Vấn đề giám sát đại trà và quyền riêng tư công dân

Một trong những điểm gây tranh cãi nhất trong vụ kiện là cáo buộc của Anthropic về việc chính quyền muốn sử dụng Claude để phân tích dữ liệu riêng tư của hàng triệu người dân Mỹ. Chính quyền Trump lập luận rằng việc sử dụng AI để nhận diện các mối đe dọa tiềm tàng là cần thiết cho an ninh quốc gia. Ngược lại, Anthropic cho rằng việc sử dụng các mô hình của họ để quét dữ liệu cá nhân mà không có sự đồng ý hoặc lệnh của tòa án là một sự vi phạm nghiêm trọng Tu chính án thứ tư của Hiến pháp Hoa Kỳ.

Cuộc chiến này đặt ra một câu hỏi lớn: Liệu các công ty công nghệ có nghĩa vụ phải trở thành cánh tay nối dài của nhà nước trong việc giám sát dân sự? Anthropic lập luận rằng việc duy trì tính trung lập và bảo mật của AI là thiết yếu để duy trì một xã hội dân chủ. Họ lo ngại rằng nếu AI bị lợi dụng để đàn áp các ý kiến trái chiều hoặc theo dõi hành vi của công dân một cách bất hợp lý, hậu quả sẽ không thể đảo ngược.

4. Vũ khí tự hành: Lời cảnh báo về tương lai chiến tranh

Bên cạnh vấn đề giám sát, Anthropic cũng kịch liệt phản đối việc tích hợp trí tuệ nhân tạo vào các hệ thống vũ khí có khả năng đưa ra quyết định tiêu diệt mà không cần sự can thiệp của con người. Trong khi Lầu Năm Góc dưới thời ông Trump đang nỗ lực đẩy nhanh cuộc đua vũ trang AI để đối đầu với các cường quốc khác, Anthropic lại giữ lập trường rằng AI nên được sử dụng để ngăn ngừa xung đột thay vì làm trầm trọng thêm mức độ tàn khốc của chúng.

Vũ khí tự hành hoàn toàn (Lethal Autonomous Weapons – LAWs) từ lâu đã bị các tổ chức nhân quyền và nhiều nhà khoa học AI phản đối vì nguy cơ gây ra các thảm họa không mong muốn do lỗi thuật toán hoặc thiếu sự đồng cảm của con người. Anthropic khẳng định họ sẽ không cho phép công nghệ của mình được sử dụng trong các nền tảng có thể tự động chọn mục tiêu và khai hỏa, bất chấp sức ép từ các hợp đồng quân sự béo bở.

5. Tác động kinh tế và tiền lệ pháp lý cho ngành AI

Vụ kiện này được dự đoán sẽ kéo dài nhiều năm và có thể lên tới Tòa án Tối cao Mỹ. Kết quả của nó sẽ quyết định quyền lực của Chính phủ trong việc kiểm soát các công ty công nghệ tư nhân. Nếu Anthropic thắng, đó sẽ là một thắng lợi lớn cho quyền tự do ngôn luận và quyền tự chủ của các nhà phát triển phần mềm. Nếu chính quyền Trump thắng, nó sẽ tạo ra một tiền lệ cho phép Nhà nước cưỡng chế các công ty AI phải xây dựng sản phẩm theo ý muốn chính trị.

Về mặt kinh tế, lệnh cấm đã khiến giá trị của Anthropic sụt giảm trên thị trường thứ cấp, đồng thời tạo cơ hội cho các đối thủ sẵn sàng hợp tác hơn với chính phủ. Tuy nhiên, nhiều nhà đầu tư vẫn đặt niềm tin vào Anthropic, tin rằng sự kiên định về đạo đức sẽ là lợi thế cạnh tranh dài hạn khi các quy định quốc tế về AI (như Đạo luật AI của EU) ngày càng trở nên nghiêm ngặt hơn. Google và Amazon, những nhà đầu tư lớn của Anthropic, hiện đang giữ thái độ thận trọng nhưng vụ kiện này chắc chắn sẽ buộc họ phải chọn phe trong tương lai gần.

6. Kết luận: Một chương mới đầy biến động của kỷ nguyên trí tuệ nhân tạo

Vụ kiện giữa Anthropic và chính quyền Trump không chỉ đơn thuần là một cuộc tranh chấp pháp lý; đó là biểu tượng của sự va chạm giữa hai tầm nhìn về tương lai. Một bên là sức mạnh quốc gia dựa trên sự kiểm soát và ứng dụng quân sự hóa công nghệ; một bên là khát vọng về một trí tuệ nhân tạo minh bạch, an toàn và phục vụ lợi ích chung của con người. Dù kết quả ra sao, hành động của Anthropic đã gửi đi một thông điệp mạnh mẽ: Trong kỷ nguyên AI, đạo đức không phải là thứ để bán, và những lằn ranh đỏ sẽ không bị xóa nhòa vì bất kỳ lợi ích chính trị hay tài chính nào.